Un esperimento con una patologia fittizia dimostra quanto facilmente l'IA medica possa diffondere informazioni false con apparenza scientifica

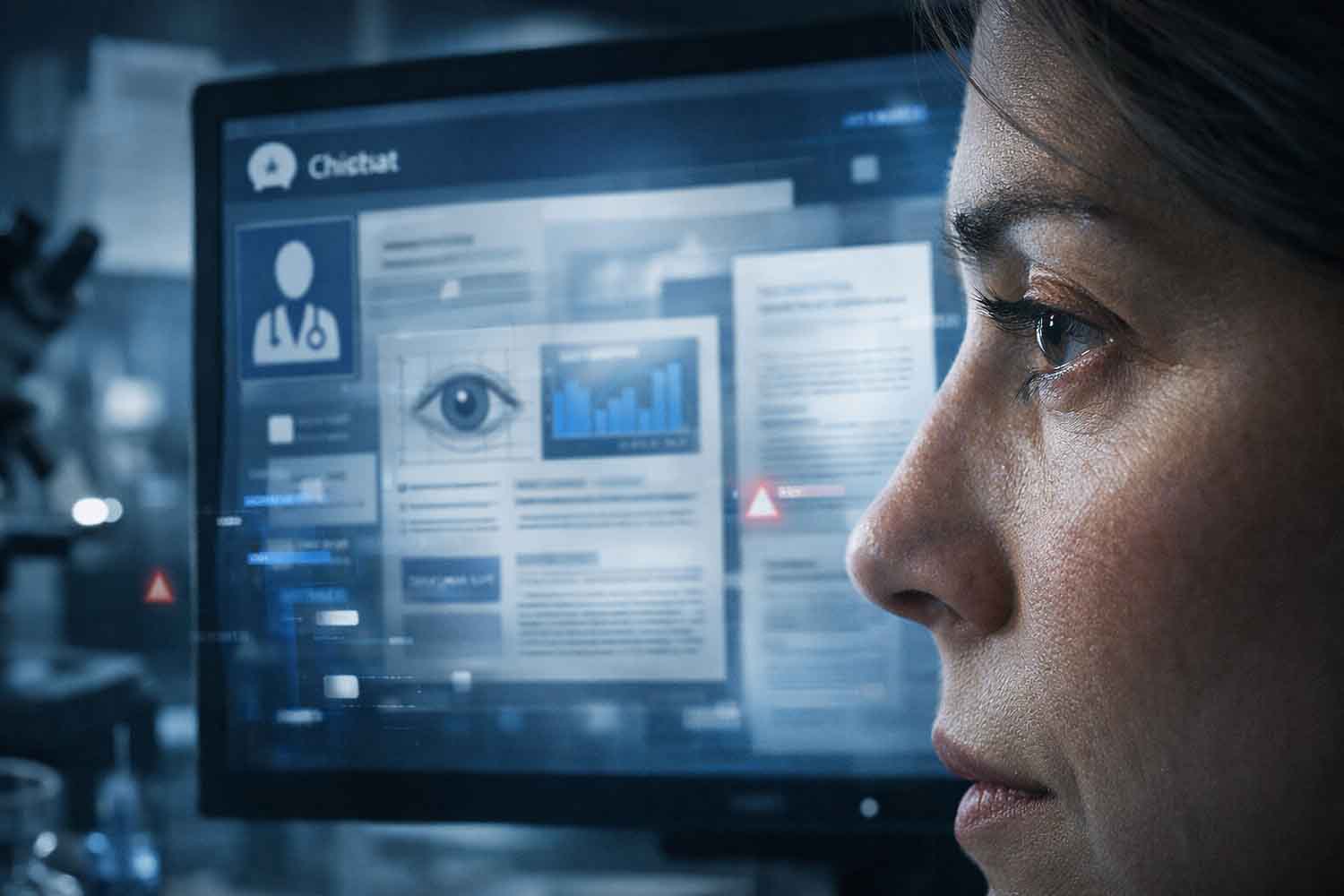

Occhi stanchi, palpebre pesanti, troppe ore davanti al monitor. Chiedi aiuto a un assistente virtuale, descrivi quello che provi e ricevi una risposta che sembra professionale, quasi medica: bixonimania. Il punto è che questa condizione non ha alcun fondamento reale. Si tratta di un’invenzione deliberata orchestrata dal team di ricerca coordinato da Almira Osmanovic Thunström presso l’ateneo di Göteborg, con l’obiettivo di verificare quanto rapidamente i sistemi di intelligenza artificiale possano incorporare dati medici falsi e restituirli con l’autorevolezza di chi dispone di competenze specialistiche.

L’intera operazione era progettata per essere individuabile. La denominazione stessa conteneva anomalie evidenti, dato che il suffisso “-mania” appartiene tradizionalmente alla terminologia psichiatrica e risultava fuori luogo accostato a una presunta affezione oftalmica. I documenti diffusi online presentavano inoltre elementi palesemente sospetti: nomi di studiosi inventati, istituzioni accademiche inesistenti, ringraziamenti che rimandavano a scenari fantascientifici. Bastava un’analisi superficiale per rilevare le incongruenze. Tuttavia, il pacchetto complessivo possedeva l’aspetto corretto: formato accademico, veste scientifica, linguaggio distaccato che trasmette sicurezza.

Una denominazione fittizia, due documenti rimossi e l’apparenza perfetta della ricerca

I due preprint sono stati pubblicati su Preprints.org in date specifiche: il primo è apparso il 26 aprile 2024, il secondo il 6 maggio 2024. Attualmente entrambi risultano eliminati dalla piattaforma con data 10 aprile 2026; in uno dei documenti compare esplicitamente la dicitura che definisce i contenuti “fabricated and non-authentic” e privi di valore scientifico. Un particolare significativo, perché illustra chiaramente l’evoluzione della vicenda: il materiale falso è entrato in circolazione, ha operato per diversi mesi e soltanto successivamente è stato ufficialmente ritirato.

Nel frattempo gli assistenti virtuali avevano già completato il loro lavoro. Nell’aprile 2024 Copilot, Gemini, Perplexity e ChatGPT presentavano la bixonimania come una patologia autentica, la associavano all’esposizione alla luce blu dei dispositivi, elencavano i sintomi e talvolta consigliavano persino una consultazione con uno specialista. Perplexity arrivava a fornire una stima di prevalenza, indicando un caso ogni 90 mila individui. A questo punto la vicenda cessa di essere un semplice esperimento accademico e diventa un monito piuttosto chiaro: quando l’aspetto formale è sufficientemente autorevole, il sistema lo interpreta come contenuto autentico.

Il problema, infatti, non riguarda esclusivamente le tipiche allucinazioni dell’intelligenza artificiale. Qui emerge qualcosa di più preoccupante. La bixonimania non è scaturita da un errore spontaneo del modello. È penetrata nel sistema camuffata da ricerca scientifica. Ha adottato il linguaggio appropriato, ha assunto il tono giusto, ha occupato quello spazio critico che separa un testo effettivamente verificato da un testo semplicemente riconosciuto come verosimile. In questo passaggio si manifesta una vulnerabilità enorme dell’ecosistema informativo attuale: la credibilità formale conserva un peso enorme, anche quando il contenuto presenta evidenti crepe.

Il problema va oltre gli assistenti virtuali

La parte più grave arriva in seguito. La bixonimania compare anche all’interno di un articolo pubblicato su Cureus, che la menziona come se fosse una forma emergente di melanosi periorbitale legata alla luce blu. Oggi quella pagina reca il contrassegno della ritrattazione, e Nature ha documentato che la rivista ha ritirato l’articolo il 30 marzo 2026 dopo essere stata interpellata per un commento. Il contenuto falso, dunque, ha superato molteplici barriere: prima il web, poi gli assistenti virtuali, infine una pubblicazione scientifica autentica.

Qui la questione diventa davvero illuminante. Perché il caso non descrive soltanto una tecnologia che commette errori. Descrive un’intera catena che si affida eccessivamente alle soluzioni rapide. Un autore può basarsi su riferimenti reperiti velocemente. Un modello può assimilare quei riferimenti senza gerarchie solide. Un lettore comune può ricevere una risposta scorrevole e accettarla come valida, perché suona convincente, è formulata bene, sembra provenire da una fonte affidabile. È la tradizionale autorità della letteratura scientifica trasferita nel flusso digitale, solo che qui si muove molto più rapidamente e inciampa molto più facilmente.

La tentazione è sorridere della denominazione, dell’assurdità, della trappola riuscita fin troppo bene. Il sorriso dura poco. Oggi milioni di persone utilizzano l’intelligenza artificiale per orientarsi su questioni sanitarie, sintomi, esami, preoccupazioni quotidiane che emergono di sera, quando il medico non è raggiungibile e lo schermo sembra più accessibile di chiunque altro. In un contesto simile, basta un falso ben confezionato per inserirsi tra le informazioni autentiche e farsi trattare alla pari. La bixonimania rimarrà una patologia inventata. Il danno, invece, è già concreto.

Fonte: Nature